- A+

明查员丨郑淑婧

背景

10月末的某一天,Timotius Susanto和往常一样,用他的TikTok账号发了几条短视频。他的视频浏览量通常并不高,不会超过300次,转评赞的数量更是少得可怜。

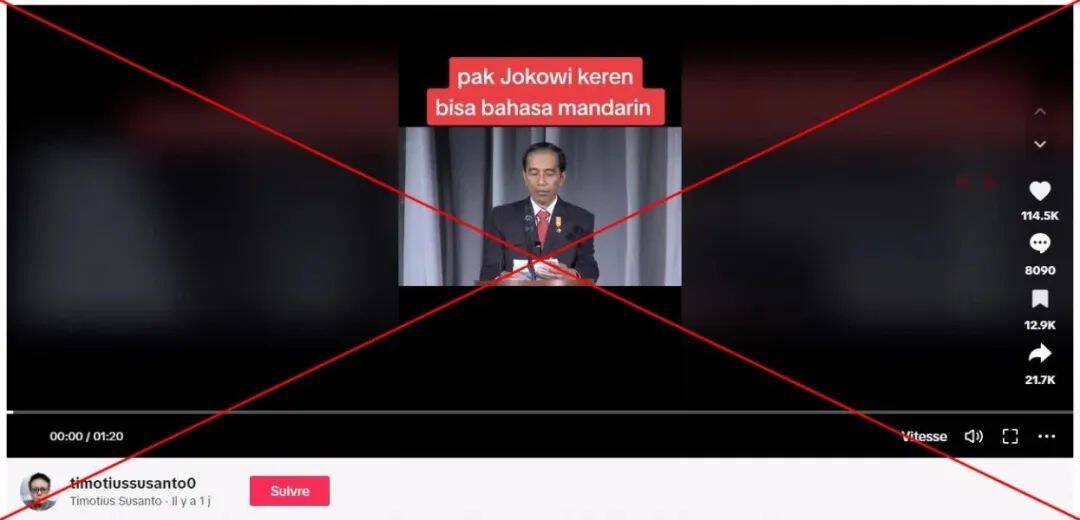

但这一天,“奇迹”发生了——他的一条关于“印尼总统佐科说中文”的视频火了,播放量超过200万次,并带来了10万点赞和近万条评论。

视频中,佐科穿着黑色西装,打着红色领带,在讲台上一脸严肃地说:“女士们,先生们,我曾经是一个商人,长达22年之久……七周前我建立了一个庞大的茶叶管理社群,致力于促进行业发展,提供交流和经验分享平台,吸引热爱茶叶的人参与。我们现在正在进行第5个茶叶监管方案,并且正在准备第6个监管方案……”

Timotius Susanto发布的“佐科说中文”的视频截图,该视频目前已经被删除

一些印尼网友信以为真,在评论区写道:“我们的总统真棒,他可以说普通话。”

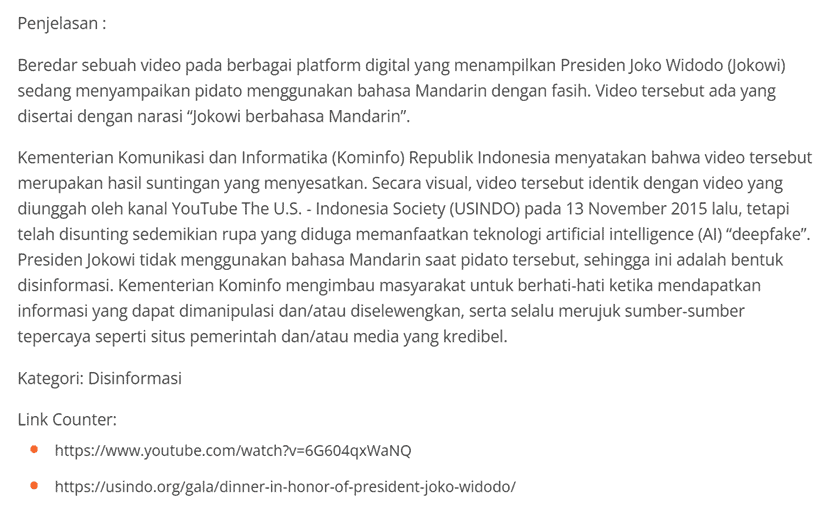

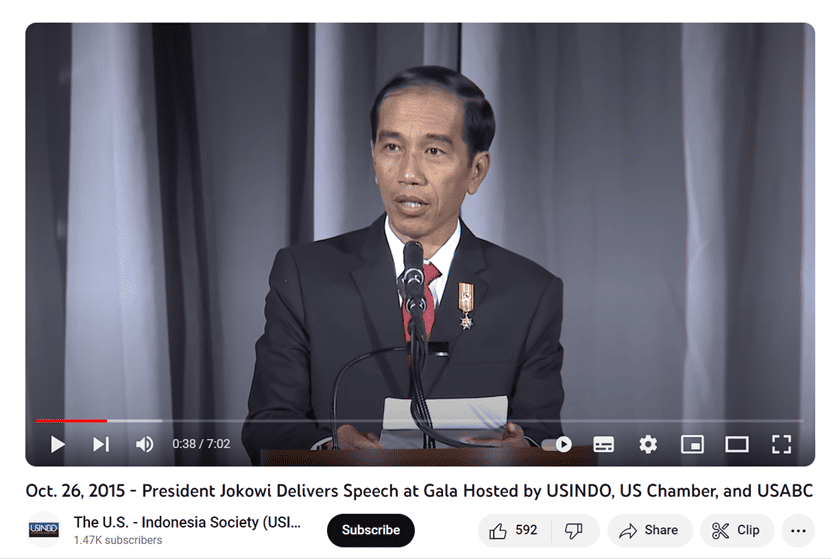

但很快,印尼的通信和信息技术部发现了这条视频。他们发布声明称:“该视频具有误导性剪辑。视觉上,该视频与YouTube频道“美国-印尼协会”(USINDO)于2015年11月13日上传的视频完全相同,但其剪辑方式被认为是利用了‘深假’(Deepfake)人工智能(AI)技术。佐科总统在演讲中没有使用普通话,因此这是一则虚假信息。”

不久后,Susanto发布的这条视频从他的TikTok账号上消失了。

印尼通信和信息技术部发布的声明截图。

印尼通信和信息技术部在通告中提到的这项“深假”技术其实并不新奇。早在2017年,社交平台Reddit上便出现了以“深假”为名的子版块,一些人利用“换脸”技术将名人肖像植入色情视频以赚取流量。

本质上,“深假”视频是一类由机器生成的视频,它可以改变人脸、身体或声音,让人们看起来做了他们从未做过的事或说了未说过的话。一些技术甚至可以在视频中添加物品、歪曲现实。近年来,随着人工智能技术的崛起和相关工具使用门槛的降低,越来越多包含深假技术的视频被生产出来,并日益发展出了新的应用场景。

例如,就在印尼官方发文澄清“佐科说中文”的视频是虚假信息同时,中文网络上流传着另一条外国名人说中文的视频,其主角是美国歌星泰勒·斯威夫特。视频中,她用一种接近两广地区口音的中文,表达了自己对新专辑的想法,无论是音色还是口型,都像是出自斯威夫特本人之口。

网络上流传的“泰勒·斯威夫特”说中文的视频截图。

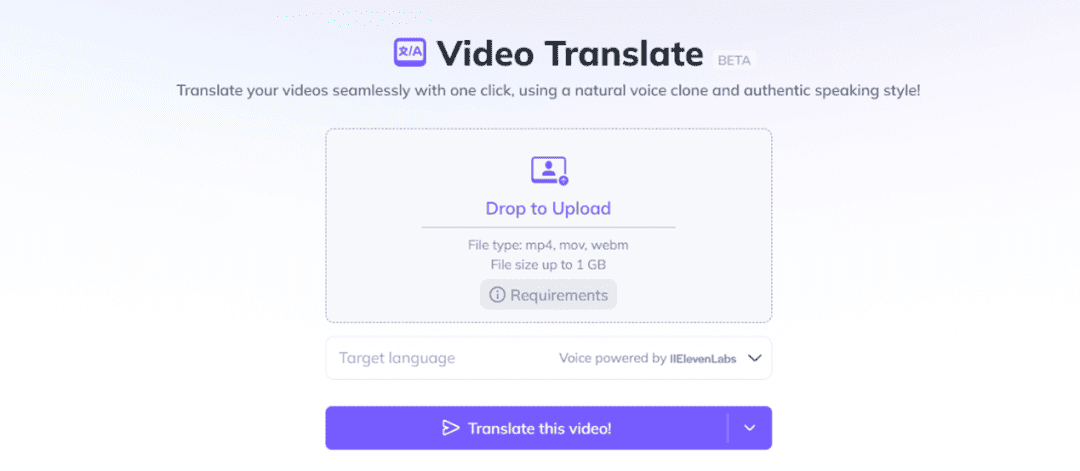

与佐科说中文的视频不同,斯威夫特讲中文的视频从一开始便打上了AI制作的标签。它的制作者@Gorden_Sun在推特上透露,自己使用了一款名为Heygen的工具。这款工具的使用方式多种多样,其中有一项名为“视频翻译”的功能,只需上传视频并选择语言便可以达到改变语言的效果。

利用Heygen,只需上传视频并选择语言便可以达到改变视频语言的效果。

Heygen目前能够提供的翻译语言有20多项,包括中文、英文、日语、法语等。而近日在社交平台上出现的赵本山、范伟、蔡明等名人说英文的视频,也是通过这款工具制作的。

@Gorden_Sun还提供了一套制作类似视频的开源替代方案,包括用Whisper进行语音转文字,用ChatGPT做文字翻译,用So-vits-svc做声音克隆并生成音频,用GeneFace++生成符合音频的嘴型等。

无可否认,“深假”的出现为部分有需求的人群带来了便利。但近年来,一些负面案例的出现也使得这项技术陷入了巨大争议。例如2022年3月,在俄乌冲突爆发初期,一段显示乌克兰总统泽连斯基劝士兵投降的视频在社交平台上流传,后被验证是用“深假”技术制作的;今年10月,脸书等平台上出现了一段用深假技术制作的视频,称拜登为支持以色列对巴勒斯坦组织哈马斯的战争,似乎准备征兵。

当越来越多诸如此类的“深假”视频被嵌入舆论场,变成一种武器,影响大众认知时,我们的疑问是:有没有什么方法,是可以帮助我们检测“深假”视频的?此处,“澎湃明查”为大家梳理了发现“深假”视频的方法和策略。

工具

对于事实核查员来说,发现“佐科说中文”的视频经过篡改并非难事。在面对视频资料时,核查员的第一反应往往是:这是否是新近出现的视频?是否能够找到视频发布的准确日期和拍摄地?

“澎湃明查”此前曾分享过有关“视频关键帧反搜”的方法,即可以通过提取视频中的关键帧图片,再对图片内容进行反向搜索,以判断网络上是否存在相同或类似的视频。这个方法对“深假”视频同样适用——法新社的事实核查团队便是通过这种方法,找到了佐科发言的视频的源头。这启示我们,在面对任何真假难辨的视频时,都可以先试一试关键帧反搜的方法。

“佐科说中文”视频的来源截图。

与之相辅相成的,还有关键词检索的方式。由于绝大多数“深假”视频是围绕社会名流、政治人物展开的,网络上往往充斥着大量与其相关的信息,我们可以通过查找这些人物的动态来辅助验证信息的可靠性。

除了关键帧反搜,许多深假视频本身的细节也能够传递出“疑似虚假”的信号。例如,一些深假视频会替换人物的面部,这可能导致人物的面部细节并不自然,在人眼周围可能出现暗淡的阴影、不真实的面部毛发、过于光滑或有皱纹的皮肤、虚构的痣和不自然的唇色等。

在面部细节上,如果人物双眼的反光并不一致,或人物口腔内部的结构呈现模糊的状态,这也有可能是“深假”视频的信号,因为人工智能技术往往不能完美再现人们说话时的口腔内部和眼球中的倒影。

美国麻省理工学院Detect Fakes实验项目的“深假”视频样本,其中人物口腔内部的结构呈现出模糊状态。

此外,如果替换仅限于面部而未包含身体,那么便有可能导致画面中的人物的身体和脸部比例不协调,或面部表情和身体动作或姿势不协调,这些都是判断潜在的“深假”视频的技巧。

除了画面图像信息外,一些技术专家还会留心视频中的音频,如视频的声音是否像正常人那样,会在句子之间停顿、喘息;使用的词语是否自然、符合口语特征;听起来是否像机器音等。

布法罗大学计算机科学与工程系教授、该校信息正直中心(Center for Information Integrity)联合主任吕思伟(Siwei Lyu)在接受事实核查机构PolitiFact采访时则提到,判断深假视频还有一个关键标志,即视频的音频是否与人物的嘴部动作同步。

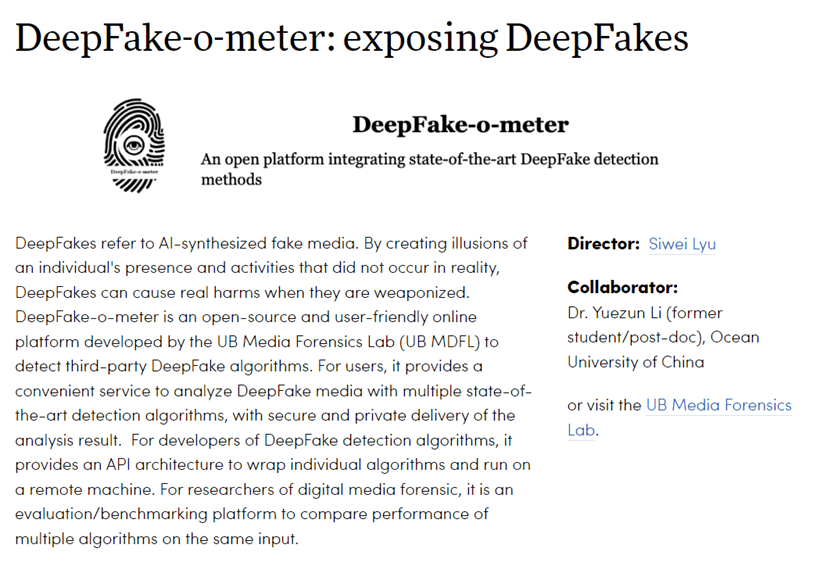

吕思伟研究深假视频已有20余年,并运行着一个名为DeepFake-o-meter的程序,该程序可以测试视频是否有被篡改的痕迹。这也是近年来人们应对“深假”视频的策略之一,即利用检测软件辅助判断视频是否使用了人工智能技术。

吕思伟的DeepFake-o-meter项目简介。该项目因被恶意使用,目前已不再对外开放。

遗憾的是,吕思伟表示,DeepFake-o-meter曾向公众开放,但由于被恶意使用,现在已不再开放。

如今市场上存在各类检测“深假”视频的工具,一些大型科技公司也披露了其各自使用的防“深假”视频的算法。例如去年11月,英特尔(Intel)发布了一款名为FakeCatcher的实时“深假”检测工具,声称其能够达到96%的检测准确率。BBC对这款工具进行了测试,肯定了其功能,但怀疑在现实世界中进行实际测试时,它们的准确性可能会大打折扣。

在吕思伟看来,阻止“深假”视频被恶意传播的解决方案之一其实很简单,即在看到它们时不要分享。

对于事实核查员而言,分享鉴别“深假”视频的方式并不是为了阻碍技术的发展,而是为了提供一把判断的量尺,减轻虚假信息对社会的负面影响。

“澎湃明查”也将持续关注“深假”视频技术的发展动态,探寻帮助人类在享受技术便利性同时应对技术应用可能导致的虚假信息泛滥之法,并分享给大家。

澎湃明查

点击“阅读原文”

进入澎湃新闻全球事实核查平台

发现“分享”和“赞”了吗,戳我看看吧

本篇文章来源于微信公众号: 澎湃明查 喜欢可以搜索关注!